微软Phi-4推理模型系列:小身材大能量,微软放大招!

一、Phi-4-reasoning:开源推理小能手

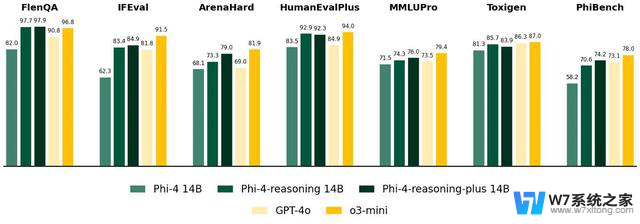

一、Phi-4-reasoning:开源推理小能手Phi-4-reasoning 是一款拥有 140 亿参数的开源推理模型。它就像是一个聪明的小助手,通过监督微调 Phi-4,再结合 OpenAI o3-mini 提供的高质量推理演示数据,利用额外计算资源,能生成详细的推理链条。简单来说,就是给它一个复杂问题,它能一步一步给你把解题思路讲得明明白白,就像老师给学生讲题一样清晰。

二、Phi-4-reasoning-plus:性能强化升级版Phi-4-reasoning-plus 这个增强版就更厉害了,它通过强化学习进一步提升性能。tokens 用量比标准版多 1.5 倍,这意味着它能支持更高精度的运算和推理。在数学推理和博士级科学问题测试中,Phi-4-reasoning 和 Phi-4-reasoning-plus 这两款模型,把 OpenAI o1-mini 和 DeepSeek-R1-Distill-Llama-70B 都给超越了。更夸张的是,在 AIME 2025(美国数学奥林匹克资格赛)中,它们居然打败了拥有 6710 亿参数的 DeepSeek-R1 满血模型。这就好比小个子选手在比赛中战胜了身材魁梧的大块头,让人不得不对这两款小型模型刮目相看。

三、Phi-4-mini-reasoning:资源有限环境的救星

三、Phi-4-mini-reasoning:资源有限环境的救星再看看 Phi-4-mini-reasoning,它是专门为计算资源有限的环境设计的。是一款基于 Transformer 的紧凑型语言模型,主打数学推理。别看它身材小(只有 3.8 亿参数),能量可不小。它通过 DeepSeek-R1 生成的合成数据微调,能在低延迟场景下,给你提供高质量的逐步问题解决方案。从中学到博士级的百万级多样化数学问题,对它来说都不在话下。在多项数学基准测试中,它的表现超越了 OpenThinker-7B 和 Llama-3.2-3B-instruct 等更大模型,甚至在部分测试中,都快赶上 OpenAI o1-mini 的水平了。无论是教育应用、嵌入式辅导,还是边缘设备部署,它都能完美适配,简直就是为这些场景量身定制的小天使。

微软这次发布的 Phi-4 推理模型系列,打破了大家对小型模型的固有认知,证明了小型模型也能在推理能力上有出色的表现,甚至能和大型前沿模型一较高下。这不仅为人工智能的发展注入了新的活力,也为开发者们提供了更多选择,在不同场景下都能找到合适的模型来解决问题。看来,人工智能领域的竞争,以后会越来越精彩啦!你对微软的这个新模型系列有什么看法呢?欢迎在评论区留言讨论。

#微软# #人工智能# #科技#